APLICA LA DISTRIBUCIÓN BINOMIAL Y DISTRIBUCIÓN DE VARIABLE ALEATORIA CONTINUAS

En estadística, la distribución binomial es una distribución de probabilidad discreta que mide el número de éxitos en una secuencia de n ensayos de Bernoulli independientes entre sí, con una probabilidad fija p

de ocurrencia del éxito entre los ensayos. Un experimento de Bernoulli

se caracteriza por ser dicotómico, esto es, sólo son posibles dos

resultados. A uno de estos se denomina éxito y tiene una probabilidad de

ocurrencia p y al otro, fracaso, con una probabilidad q = 1 - p. En la distribución binomial el anterior experimento se repite n veces, de forma independiente, y se trata de calcular la probabilidad de un determinado número de éxitos. Para n = 1, la binomial se convierte, de hecho, en una distribución de Bernoulli.

Para representar que una variable aleatoria X sigue una distribución binomial de parámetros n y p, se escribe:

La distribución binomial es la base del test binomial de significación estadística

Las siguientes situaciones son ejemplos de experimentos que pueden modelizarse por esta distribución:

- Se lanza un dado diez veces y se cuenta el número X de tres obtenidos: entonces X ~ B(10, 1/6)

- Se lanza una moneda dos veces y se cuenta el número X de caras obtenidas: entonces X ~ B(2, 1/2)

Supongamos que se lanza un

dado (con 6 caras) 50 veces y queremos conocer la probabilidad de que el número

3 salga 20 veces. En este caso tenemos una X ~ B(50, 1/6) y la probabilidad

sería P(X=20):

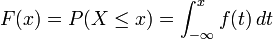

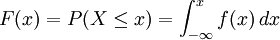

En teoría de la probabilidad una distribución de probabilidad se llama continua si su función de distribución es continua. Puesto que la función de distribución de una variable aleatoria X viene dada por  , la definición implica que en una distribución de probabilidad continua X se cumple P[X = a] = 0 para todo número real a, esto es, la probabilidad de que X tome el valor a es cero para cualquier valor de a. Si la distribución de X es continua, se llama a X variable aleatoria continua.

, la definición implica que en una distribución de probabilidad continua X se cumple P[X = a] = 0 para todo número real a, esto es, la probabilidad de que X tome el valor a es cero para cualquier valor de a. Si la distribución de X es continua, se llama a X variable aleatoria continua.

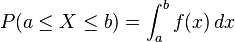

En las distribuciones de probabilidad continuas, la distribución de probabilidad es la integral de la función de densidad, por lo que tenemos entonces que:

Existe una definición alternativa más rigurosa en la que el término "distribución de probabilidad continua" se reserva a distribuciones que tienen función de densidad de probabilidad. Estas funciones se llaman, con más precisión, variables aleatorias absolutamente continuas (véase el Teorema de Radon-Nikodym). Para una variable aleatoria X absolutamente continua es equivalente decir que la probabilidad P[X = a] = 0 para todo número real a, en virtud de que hay un incontables conjuntos de medida de Lebesgue cero (por ejemplo, el conjunto de Cantor).

Una variable aleatoria con la distribución de Cantor es continua de acuerdo con la primera definición, pero según la segunda, no es absolutamente continua. Tampoco es discreta, ni una media ponderada de variables discretas y absolutamente continuas.

En aplicaciones prácticas, las variables aleatorias a menudo ofrece una distribución discreta o absolutamente continua, aunque también aparezcan de forma natural mezclas de los dos tipos.

En el caso de variable continua la distribución de probabilidad es la integral de la función de densidad, por lo que tenemos entonces que:

una variable continua, una distribución de probabilidad o función de densidad de probabilidad (FDP) de

una variable continua, una distribución de probabilidad o función de densidad de probabilidad (FDP) de  es una función

es una función  tal que, para cualesquiera dos números

tal que, para cualesquiera dos números  y

y  siendo

siendo  .

.

La gráfica de se conoce a veces como curva de densidad, la probabilidad de que

se conoce a veces como curva de densidad, la probabilidad de que  tome un valor en el intervalo

tome un valor en el intervalo ![[a,b]](http://upload.wikimedia.org/math/2/c/3/2c3d331bc98b44e71cb2aae9edadca7e.png) es el área bajo la curva de la función de densidad; así, la función

mide concentración de probabilidad alrededor de los valores de una

variable aleatoria continua.

es el área bajo la curva de la función de densidad; así, la función

mide concentración de probabilidad alrededor de los valores de una

variable aleatoria continua.

Para que sea una FDP (

sea una FDP ( ) legítima, debe satisfacer las siguientes dos condiciones:

) legítima, debe satisfacer las siguientes dos condiciones:

Ya que la probabilidad es siempre un número positivo, la FDP es una función no decreciente que cumple:

Algunas FDP están declaradas en rangos de a

a  , como la de la distribución normal.

, como la de la distribución normal.

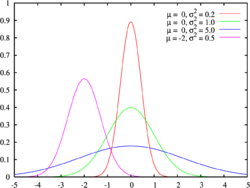

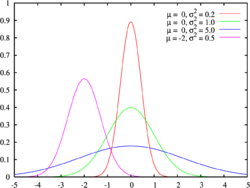

En estadística y probabilidad

se llama distribución normal, distribución de Gauss o distribución gaussiana, a una de las distribuciones

de probabilidad de variable continua que con más frecuencia aparece aproximada

en fenómenos reales.

La gráfica de su función de densidad tiene una forma acampanada y es simétrica respecto de un determinado parámetro estadístico. Esta curva se conoce como campana de Gauss y es el gráfico de una función gaussiana.

La importancia de esta distribución radica en que permite modelar numerosos fenómenos naturales, sociales y psicológicos. Mientras que los mecanismos que subyacen a gran parte de este tipo de fenómenos son desconocidos, por la enorme cantidad de variables incontrolables que en ellos intervienen, el uso del modelo normal puede justificarse asumiendo que cada observación se obtiene como la suma de unas pocas causas independientes.

De hecho, la estadística es un modelo matemático que sólo permite describir un fenómeno, sin explicación alguna. Para la explicación causal es preciso el diseño experimental, de ahí que al uso de la estadística en psicología y sociología sea conocido como método correlacional.

La distribución normal también es importante por su relación con la estimación por mínimos cuadrados, uno de los métodos de estimación más simples y antiguos.

Algunos ejemplos de variables asociadas a fenómenos naturales que siguen el modelo de la normal son:

En probabilidad, la distribución normal aparece como el límite de varias distribuciones de probabilidad continuas y discretas.

Ejemplo 6:

Un agente de seguros vende pólizas a cinco personas de la misma edad y

que

disfrutan de buena salud. Según las tablas actuales, la probabilidad de que

una persona en esta s condiciones viva 30 años o más es 2/3. Hállese la

probabilidad de que, transcurridos 30 años, vivan:

disfrutan de buena salud. Según las tablas actuales, la probabilidad de que

una persona en esta s condiciones viva 30 años o más es 2/3. Hállese la

probabilidad de que, transcurridos 30 años, vivan:

1. Las cinco personas.

B(5, 2/3) p = 2/3 q = 1/3

2.Al menos tres personas.

3.Exactamente dos personas.

Si de seis a siete de la tarde se admite que un número de teléfono de

cada cinc

o está comunicando, ¿cuál es la probabilidad de que, cuando se marquen

10 números de teléfono elegidos al azar, sólo comuniquen dos?

o está comunicando, ¿cuál es la probabilidad de que, cuando se marquen

10 números de teléfono elegidos al azar, sólo comuniquen dos?

B(10, 1/5)p = 1/5q = 4/5

La probabilidad de que un hombre acierte en el blanco es 1/4. Si dispara

10 veces

¿cuál es la probabilidad de que acierte exactamente en tres ocasiones?

¿Cuál es la probabilidad de que acierte por lo menos en una ocasión?

¿cuál es la probabilidad de que acierte exactamente en tres ocasiones?

¿Cuál es la probabilidad de que acierte por lo menos en una ocasión?

B(10, 1/4) p = 1/4q = 3/4

En una urna hay 30 bolas, 10 rojas y el

resto blancas. Se elige una bola al azar

y se anota si es roja;

el proceso se repite, devolviendo la bola, 10 veces.

Calcular la media y la desviación típica.

B(10, 1/3) p = 1/3q = 2/3

lanza una moneda cuatro veces. Calcular la probabilidad de que salgan

más

caras que cruces

.

caras que cruces

.

B(4, 0.5) p = 0.5q = 0.5

DISTRIBUCIÓN DE PROBABILIDAD CON VARIABLES

CONTINUAS

, la definición implica que en una distribución de probabilidad continua X se cumple P[X = a] = 0 para todo número real a, esto es, la probabilidad de que X tome el valor a es cero para cualquier valor de a. Si la distribución de X es continua, se llama a X variable aleatoria continua.

, la definición implica que en una distribución de probabilidad continua X se cumple P[X = a] = 0 para todo número real a, esto es, la probabilidad de que X tome el valor a es cero para cualquier valor de a. Si la distribución de X es continua, se llama a X variable aleatoria continua.En las distribuciones de probabilidad continuas, la distribución de probabilidad es la integral de la función de densidad, por lo que tenemos entonces que:

Existe una definición alternativa más rigurosa en la que el término "distribución de probabilidad continua" se reserva a distribuciones que tienen función de densidad de probabilidad. Estas funciones se llaman, con más precisión, variables aleatorias absolutamente continuas (véase el Teorema de Radon-Nikodym). Para una variable aleatoria X absolutamente continua es equivalente decir que la probabilidad P[X = a] = 0 para todo número real a, en virtud de que hay un incontables conjuntos de medida de Lebesgue cero (por ejemplo, el conjunto de Cantor).

Una variable aleatoria con la distribución de Cantor es continua de acuerdo con la primera definición, pero según la segunda, no es absolutamente continua. Tampoco es discreta, ni una media ponderada de variables discretas y absolutamente continuas.

En aplicaciones prácticas, las variables aleatorias a menudo ofrece una distribución discreta o absolutamente continua, aunque también aparezcan de forma natural mezclas de los dos tipos.

Definición

Para una variable continua hay infinitos valores posibles de la variable y entre cada dos de ellos se pueden definir infinitos valores más. En estas condiciones no es posible deducir la probabilidad de un valor puntual de la variable; como se puede hacer en el caso de variables discretas, pero es posible calcular la probabilidad acumulada hasta un cierto valor (función de distribución de probabilidad), y se puede analizar como cambia la probabilidad acumulada en cada punto (estos cambios no son probabilidades sino otro concepto: la función de densidad.En el caso de variable continua la distribución de probabilidad es la integral de la función de densidad, por lo que tenemos entonces que:

una variable continua, una distribución de probabilidad o función de densidad de probabilidad (FDP) de

una variable continua, una distribución de probabilidad o función de densidad de probabilidad (FDP) de  es una función

es una función  tal que, para cualesquiera dos números

tal que, para cualesquiera dos números  y

y  siendo

siendo  .

.La gráfica de

se conoce a veces como curva de densidad, la probabilidad de que

se conoce a veces como curva de densidad, la probabilidad de que  tome un valor en el intervalo

tome un valor en el intervalo ![[a,b]](http://upload.wikimedia.org/math/2/c/3/2c3d331bc98b44e71cb2aae9edadca7e.png) es el área bajo la curva de la función de densidad; así, la función

mide concentración de probabilidad alrededor de los valores de una

variable aleatoria continua.

es el área bajo la curva de la función de densidad; así, la función

mide concentración de probabilidad alrededor de los valores de una

variable aleatoria continua. área bajo la curva de

área bajo la curva de  entre

entre  y

y

Para que

sea una FDP (

sea una FDP ( ) legítima, debe satisfacer las siguientes dos condiciones:

) legítima, debe satisfacer las siguientes dos condiciones:- 1.

0 para toda

0 para toda  .

.

- 2.

Ya que la probabilidad es siempre un número positivo, la FDP es una función no decreciente que cumple:

- 1.

. Es decir, la probabilidad de todo el espacio muestral es 1.

. Es decir, la probabilidad de todo el espacio muestral es 1.

- 2.

. Es decir, la probabilidad del suceso nulo es cero.

. Es decir, la probabilidad del suceso nulo es cero.

Algunas FDP están declaradas en rangos de

a

a  , como la de la distribución normal.

, como la de la distribución normal.

DISTRIBUCIÓN NORMAL

La gráfica de su función de densidad tiene una forma acampanada y es simétrica respecto de un determinado parámetro estadístico. Esta curva se conoce como campana de Gauss y es el gráfico de una función gaussiana.

La importancia de esta distribución radica en que permite modelar numerosos fenómenos naturales, sociales y psicológicos. Mientras que los mecanismos que subyacen a gran parte de este tipo de fenómenos son desconocidos, por la enorme cantidad de variables incontrolables que en ellos intervienen, el uso del modelo normal puede justificarse asumiendo que cada observación se obtiene como la suma de unas pocas causas independientes.

De hecho, la estadística es un modelo matemático que sólo permite describir un fenómeno, sin explicación alguna. Para la explicación causal es preciso el diseño experimental, de ahí que al uso de la estadística en psicología y sociología sea conocido como método correlacional.

La distribución normal también es importante por su relación con la estimación por mínimos cuadrados, uno de los métodos de estimación más simples y antiguos.

Algunos ejemplos de variables asociadas a fenómenos naturales que siguen el modelo de la normal son:

- caracteres morfológicos de individuos como la estatura;

- caracteres fisiológicos como el efecto de un fármaco;

- caracteres sociológicos como el consumo de cierto producto por un mismo grupo de individuos;

- caracteres psicológicos como el cociente intelectual;

- nivel de ruido en telecomunicaciones;

- errores cometidos al medir ciertas magnitudes;

- etc.

En probabilidad, la distribución normal aparece como el límite de varias distribuciones de probabilidad continuas y discretas.

No hay comentarios:

Publicar un comentario